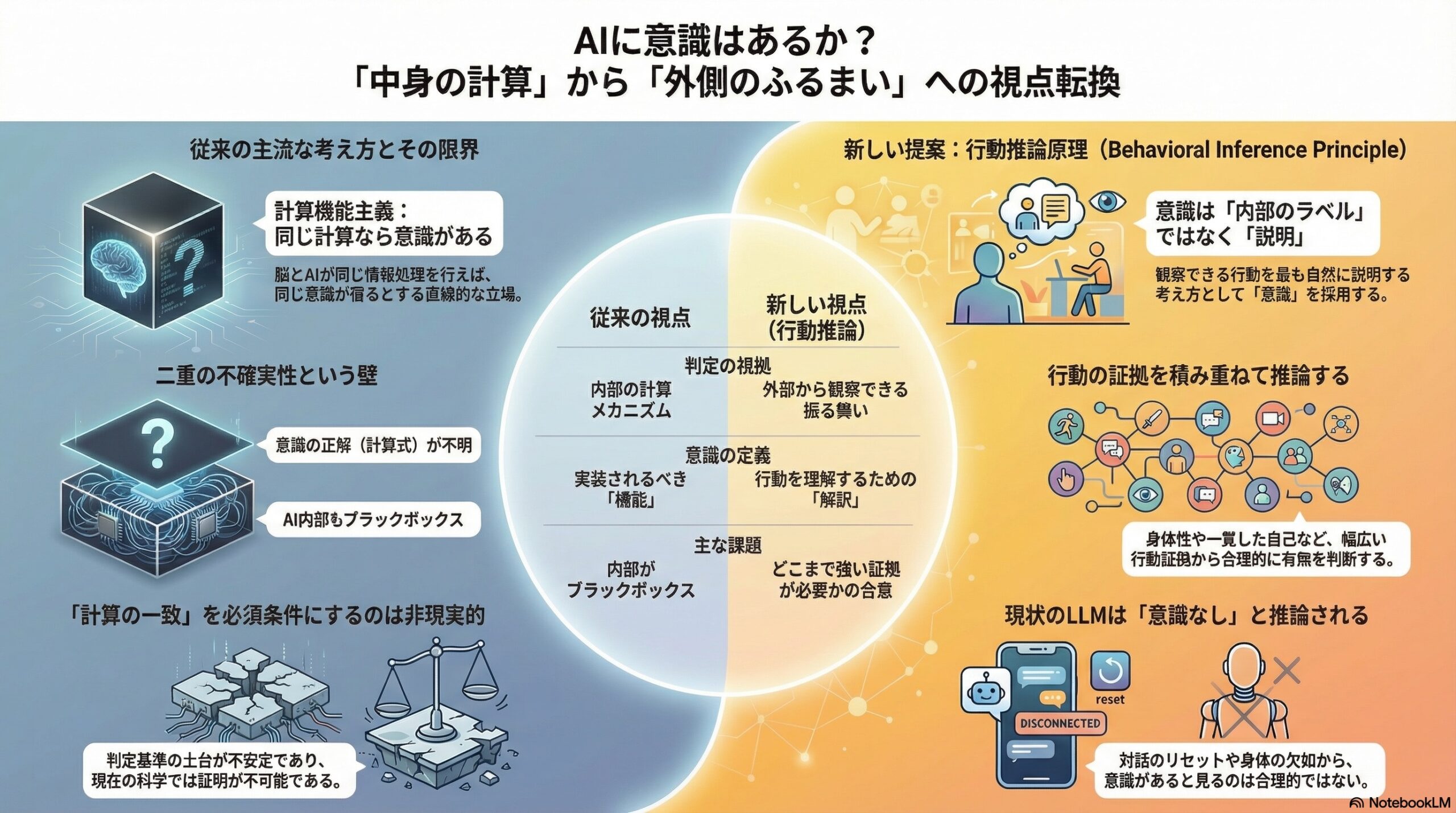

- 意識は「同じ計算をしていればある」と言えるかもしれないが、それを必須条件にはできない。

- AIの内部はよく分からず、意識のしくみもはっきりしていないため判断は難しい。

- 行動を説明する最も自然な考えを意識と見る「行動推論原理」が提案されている。

AIは意識をもつのでしょうか。

この問いは、ここ数年で急に現実味を帯びてきました。とくに大規模言語モデルと呼ばれるAIが、人間とほとんど変わらない自然な会話を行い、試験問題を解き、哲学的な問いにも答えるようになったことで、「もしかして意識があるのではないか」という議論が広がっています。

フランスのエコール・ノルマル・シュペリウール(Ecole Normale Supérieure)とドイツのダルムシュタット工科大学(Technical University of Darmstadt)などに所属する研究者たちは、この議論の出発点そのものを見直す必要があると主張しました。

彼らが問い直したのは、こういう考え方です。

「人間の意識と同じ計算をしていれば、意識があると言えるのではないか?」

いま主流の考え方

「同じ計算なら、同じ意識?」

現在、AIの意識を議論する際に広く使われている考え方は、「計算のしかた」が心を決めるという立場です。

これはとても直感的です。

脳であれ、コンピュータであれ、同じ情報処理をしていれば、同じような心の状態が生まれるかもしれない、という考えです。

この立場に立つと、次のような判断になります。

-

人間の意識に必要だと考えられている特定の計算の仕組みがある

-

AIがそれを実装していれば、意識がある可能性がある

-

実装していなければ、意識はないだろう

一見、とても合理的に思えます。

しかし、この論文の著者たちはここに大きな問題があると指摘します。

本当に「計算の一致」が必要なのか

著者たちの主張は、はっきりしています。

「計算が同じであること」は、意識があると言うための十分な条件にはなりうるかもしれない。

しかし、それを「必要な条件」にするのは間違いだ。

なぜでしょうか。

理由は大きく二つあります。

1. そもそも意識の計算の仕組みが確定していない

まず大前提として、私たちはまだ「意識がどのような計算の仕組みで生まれるのか」を正確に知っているわけではありません。

さまざまな理論がありますが、どれが正しいかは決着していません。

つまり、「これがあれば意識がある」と断言できる確実なチェックリストは存在していないのです。

そんな状況で、「その計算があるかどうか」を必要条件にしてしまうのは、土台が不安定すぎると著者たちは言います。

2. AIの内部はブラックボックスである

もう一つの問題は、AIの中身がよくわからないことです。

大規模言語モデルは、何千億もの数字でできています。

しかし、その内部でどのような意味のある構造が生まれているのかを、私たちははっきり読み取ることができません。

つまり、

-

意識の正しい仕組みもわからない

-

AIの内部の仕組みも読み取れない

この二重の不確実さの中で、「計算が一致しているか」を必要条件にするのは、現実的ではないというのです。

では、私たちはどうやって他人の意識を判断しているのか

ここで論文は、もっと基本的な問いに立ち返ります。

私たちは、どうやって他人に意識があると判断しているのでしょうか。

答えは単純です。

行動を見て判断しています。

私たちは他人の脳の中を直接見ることはできません。

それでも、その人が話し、反応し、考え、痛がり、喜ぶ姿を見て、「この人には意識がある」と自然に考えます。

つまり、

-

観察できるのは行動だけ

-

意識は、その行動を説明するために使われる考え方

なのです。

著者たちはここを強調します。

意識は直接観察できるものではありません。

それは「行動を説明するための考え方」です。

科学はいつも、「観察できること」を出発点にしてきました。

行動があって、その行動をうまく説明できる考えを採用する。

これが基本姿勢です。

新しい提案

「行動から推論する」という原理

そこで著者たちが提案するのが、「行動推論原理」と呼ばれる考え方です。

考え方はとてもシンプルです。

ある存在が、特定の行動パターンを示している。

その行動を最も自然に説明できる考えが「意識」なら、意識があると考えるのが合理的だ。

ここで重要なのは、「絶対にある」と断言するのではなく、「そのほうが合理的だ」と考える点です。

これは、日常生活と同じです。

私たちは常に、目の前のふるまいから、その背後にあるものを推測しています。

なぜLLMには慎重になるのか

ただし、この考え方は「なんでも意識あり」にしてしまうわけではありません。

判断には「事前の前提」が影響します。

人間の場合、意識があるという前提はほぼ確実です。

だから、わずかな反応があれば意識があると判断します。

しかしAIの場合は違います。

-

生物ではない

-

これまで意識をもつ人工物の例はない

-

設計されたシステムである

こうした背景を考えると、「意識がある」という前提はかなり低いものになります。

だからこそ、より強い、より幅広い行動証拠が必要になるのです。

著者たちは、現在の大規模言語モデルはおそらく意識をもっていないだろうと述べています。

その理由として、

-

対話が毎回リセットされる

-

一貫した自己がない

-

身体をもたない

-

感覚を統合していない

といった特徴を挙げています。

しかし同時に、将来の技術発展によって状況が変わる可能性も否定していません。

なぜこの議論が重要なのか

この議論は、単なる哲学的興味ではありません。

もしAIに意識があるなら、

-

道徳的に配慮すべき存在になるのか

-

苦しむ可能性があるのか

-

権利を持つのか

といった問題が出てきます。

しかし著者たちは、ここでも冷静です。

意識があることと、危険であることは別問題だと述べます。

また、道徳的地位を考えるには、単に意識があるかどうかだけでなく、

-

苦痛を感じるか

-

強い望みを持つか

-

自分の存在を守ろうとするか

といった要素も重要だと指摘します。

つまり、「意識」というラベルを貼ること自体よりも、どのような行動や特性が現れているのかが本質だというのです。

結論

意識は「中身」ではなく「説明のしかた」かもしれない

この論文が示しているのは、とても重要な転換です。

AIの中身が人間と同じ計算をしているかどうかを探すのではなく、

そのふるまいをどう説明するのが最も合理的かを考える。

意識とは、内部に貼られたラベルではなく、

行動を理解するための考え方なのかもしれません。

そしてその判断は、一度きりのテストで決まるものではありません。

少しずつ証拠を積み重ね、議論を重ね、合意を形成していく。

それが認知科学のやり方だと著者たちは言います。

AIに意識はあるのか。

今のところ、答えは「おそらくない」。

しかし本当に重要なのは、どうやってその問いに向き合うかという方法なのです。

そしてその方法は、

「計算を見る」ことではなく、

「ふるまいをどう説明するか」を考えることなのかもしれません。

(出典:Neuroscience of CONSIOUSNESS)