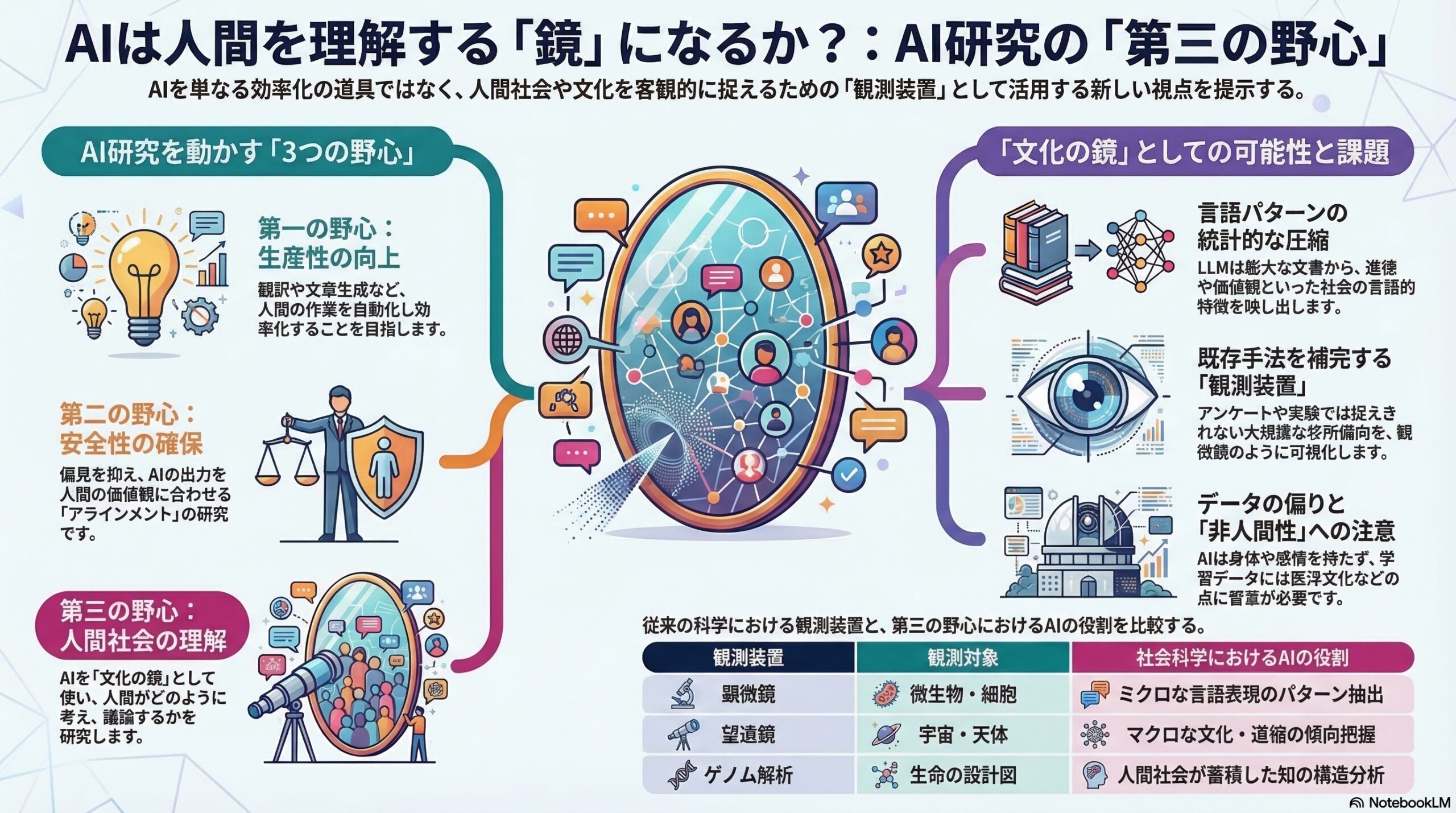

- AIには仕事を増やすことと安全に使うことの二つの大きな目標がある。

- 第三の野心は、AIを使って人間の文化や行動を理解する観測装置として活用すること。

- AIは人間の思考をそのまま反映するわけではなく、言語のデータから社会のパターンを読み取る補助的な道具として捉えられる。

「第三の野心」が示す、新しい社会科学の可能性

人工知能(AI)について語るとき、多くの場合、議論は二つの方向に集中します。

ひとつは「AIはどれだけ仕事を効率化できるのか」という問題です。

もうひとつは「AIを安全に、人間の価値観に沿って動かすにはどうすればよいのか」という問題です。

しかし近年、これとは少し違う視点が静かに現れ始めています。

それは、AIを人間そのものを理解するための科学的な道具として使うという発想です。

この新しい視点は、アメリカの**ニューヨーク大学(New York University)**の研究者たちによって提案されました。研究では、大規模言語モデルを社会科学の研究装置として捉える新しい枠組みが論じられています。

この考え方は、AI研究の方向を変える可能性があります。

AIは単なる便利なツールではなく、人間社会を観察するための「望遠鏡」や「顕微鏡」のような存在になるかもしれないのです。

AI研究を動かしてきた二つの目標

現代のAI研究は、主に二つの大きな目標によって動いてきました。

生産性を高めるAI

第一の目標は、生産性です。

AIを使って仕事を自動化し、効率を上げることです。

翻訳、文章生成、画像認識、プログラム生成、物流の最適化など、AIはさまざまな分野で作業を高速化しています。企業や政府は、AIを経済成長を支える重要な技術として期待しています。

この考え方では、AIは「何かを実行する機械」です。

人間の作業を補助したり、代替したりする存在として開発されています。

AIを安全にする研究

第二の目標は、AIを安全にすることです。

AIの能力が急速に高まるにつれて、

・偏見のある出力

・誤情報の生成

・危険な利用

・人間の制御を超える可能性

といった問題が議論されるようになりました。

そのため、AIの出力を人間の価値観や社会規範に合わせる研究が進められています。この分野は一般に「アラインメント」と呼ばれます。

ここでの中心的な問いは、

AIは何ができるかではなく、AIはどのように振る舞うべきか

というものです。

第三の野心

AIを人間研究の道具として使う

研究者たちは、この二つの目標の先に、もう一つの可能性があると考えています。

それが、

AIを使って人間の文化や行動を研究する

という方向です。

大規模言語モデルは、膨大な量の人間の文章を学習して作られています。

そこには

・本

・ニュース記事

・法律文書

・オンライン掲示板

・SNS

・宗教的文章

・日常会話

など、人間社会が生み出してきた多様な言語が含まれています。

これらの文章には、人間が

・どのように議論するか

・どのように正当化するか

・どのように道徳を語るか

・どのように感情を表現するか

といったパターンが大量に含まれています。

研究者たちは、言語モデルを

人間社会の言語的行動を統計的に圧縮した存在

と捉えています。

つまり、AIは人間の思考そのものではありませんが、人間社会の言語のパターンを大量に反映している存在だと考えられるのです。

AIは「文化の鏡」になる可能性

この考え方では、AIは人間の心を直接理解しているわけではありません。

しかし、AIは膨大な人間の文章を学習しているため、

・どの価値観がよく語られるか

・どの道徳が重視されるか

・どのような論理が一般的か

といった文化的な傾向を統計的に反映している可能性があります。

研究者たちは、この特徴を利用することで、次のような問いを調べることができるかもしれないと考えています。

例えば、

・人は公平さと忠誠心のどちらを重視するのか

・結果とルールが衝突したとき、人はどちらを選ぶのか

・権威や集団が判断にどのように影響するのか

といった問題です。

こうした研究はこれまで、

・アンケート

・心理実験

・民族誌研究

などによって行われてきました。

AIを使う方法は、それらに代わるものではありません。

しかし、これまで観察できなかった大規模な言語パターンを分析できる可能性があります。

科学は「観測装置」で進歩する

研究では、科学史の視点も紹介されています。

科学の大きな進歩は、新しい理論だけでなく、新しい観測装置によっても起こってきました。

顕微鏡は微生物の存在を明らかにしました。

望遠鏡は宇宙の理解を大きく変えました。

ゲノム解析は生命科学の研究を変えました。

こうした装置は、これまで見えなかった現象を観察できるようにしました。

研究者たちは、言語モデルも同じような役割を持つ可能性があると考えています。

言語モデルは、膨大な人間の言語行動を一つのシステムの中に取り込み、そこからパターンを観察できるようにするからです。

しかしAIは人間ではない

もちろん、この方法には大きな注意点もあります。

AIは人間ではありません。

人間の学習は、

・身体的な経験

・感情

・社会関係

・発達過程

などと深く結びついています。

一方、言語モデルはテキストから統計的パターンを学習しているだけです。

そのため、AIの出力をそのまま人間の心理だと解釈することはできません。

また、AIの学習データには偏りがあります。

インターネットの文章は

・英語圏

・西洋文化

・オンライン社会

の影響を強く受けています。

そのため、AIが反映しているのは人類全体の文化ではなく、特定の社会の言語文化の可能性もあります。

AIは社会科学を置き換えるのか

研究者たちは、この方法が社会科学を置き換えるとは考えていません。

むしろ、

既存の研究方法を補完するもの

だと位置づけています。

AIによって見つかったパターンは、

・アンケート

・心理実験

・歴史研究

・民族誌

などと比較され、検証される必要があります。

つまりAIは、人間研究の「新しい観測装置」として使われるべきだという立場です。

AI研究の未来

研究者たちは、この新しい方向を「第三の野心」と呼んでいます。

第一の野心

AIで仕事を効率化すること

第二の野心

AIを安全にすること

そして第三の野心は、

AIを使って人間社会を理解すること

です。

言語モデルは、人間社会が生み出してきた膨大な言語の痕跡を圧縮した存在です。

それは人間の思考そのものではありません。

しかし、人間がどのように世界を語り、説明し、議論してきたのかというパターンを映し出している可能性があります。

AIを研究対象として見るだけでなく、

AIを人間を理解するための観測装置として使う。

もしこの発想が広がれば、社会科学の研究方法そのものが変わるかもしれません。

ただし、そのためには慎重な研究設計と検証が必要です。

AIが映し出しているものは、人間の思考そのものではありません。

それは、人間社会の言語が残してきた統計的な痕跡です。

その痕跡をどのように読み解くのか。

それが、これからの社会科学にとって新しい課題になるのかもしれません。

(出典:arXiv DOI: 10.48550/arXiv.2603.07329)