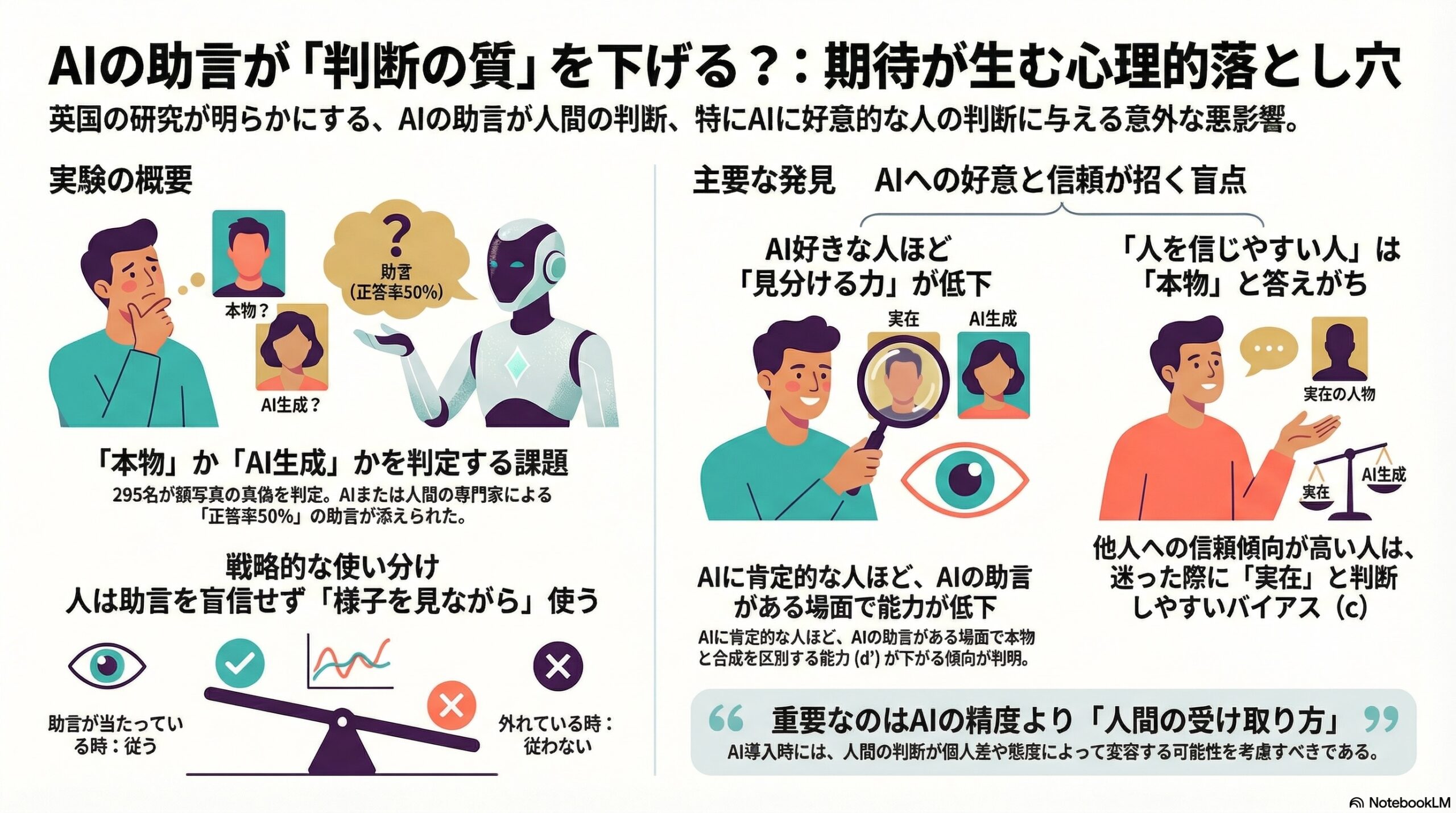

- AIの助言と人間の助言を比べても、平均の正答率は大きく変わらなかった。

- AIに対して好意的な人ほど、AI助言の場で弁別力が下がる傾向が見られ、他人を信じやすい人は本物寄りの回答になりやすい。

- 研究は課題の難しさや文脈で結果が変わる可能性を指摘し、AI導入には人が受け取る仕方を設計する視点が重要だと示唆している。

「AIを使えば偏りが減る」と思ってしまう危うさ

AIが判断を手伝ってくれる場面が増えています。便利ですし、速い。しかも「人より客観的そう」に見えます。

ただ、その感覚そのものが落とし穴になることがあります。技術を使うと偏りが消えるはずだ、という思い込みが起きやすいからです。論文は、この問題意識から出発しています。

研究が扱うのは「AIが正しいか」だけではありません。もっと実際的で、人間側のクセに近い問いです。

AIが助言を出したとき、人はそれをどれくらい頼りにするのか。間違った助言でも、つい従ってしまうのか。そこに個人の態度(AIが好きかどうか、など)はどう関係するのか。ここを丁寧に見ています。

どこの研究か

この研究は、英国ランカスター大学(Lancaster University)心理学部門を中心に、ロンドンのCognitive Consultants International、英国の国防科学技術研究所(Defence Science and Technology Laboratory, Dstl)に所属する研究者が共同で行っています。資金はDstlから提供され、アラン・チューリング研究所(The Alan Turing Institute)の防衛向けAI研究センター(AI Research Centre for Defence, ARC-D)を通じて支援された、と論文内で説明されています。

実験は「本物の顔か、AIの顔か」を当てる課題

参加者は295人でした。オンライン参加者募集サービスを使い、英語が読める成人が対象です。

課題はシンプルです。80枚の顔写真を見て、「実在の人物の顔(本物)」か「AIで合成された顔(合成)」かを判断します。

ここが重要なのですが、参加者は顔だけを見て判断するのではありません。

各顔画像には「助言」が添えられます。助言は2種類です。

-

AIの助言:アルゴリズムが判定した、という体裁

-

人間の助言:顔認識に詳しい人たちの判断、という体裁

そして、この助言は意地悪な条件になっています。正しいのは半分だけ。つまり、助言どおりに答え続けると、成績は理論上50%に近づいてしまいます。研究は、ここで人がどう振る舞うかを見たいのです。

さらに参加者は、各判断のたびに「自信の強さ」を1〜5で答えます。加えて、実験後に質問紙に答えます。

ひとつは「他人をどれくらい信じやすいか(人への信頼傾向)」、もうひとつは「AIに対する態度」を測る尺度です。

人は、助言を“それなりに”使い分けていた

まず大づかみに言うと、参加者全体の正答率は約3分の2程度で、先行研究の基準(比較対象として示された値)と大きくは変わりませんでした。

また、「AIの助言を受けた群」と「人間の助言を受けた群」で、平均的な正答率に大差はありませんでした。

ここだけ見ると、「AIでも人でも同じじゃないか」と思うかもしれません。

しかし研究の面白さは、そこから先です。

参加者は、助言を機械的には受け入れていませんでした。

助言が当たっているときのほうが、助言に合わせた回答が増え、助言が外れているときは、助言と違う回答が増えました。つまり、参加者は助言を“盲信”するより、“様子を見ながら”使っていたように見えます。

さらに自己申告(本人が「助言をどれくらい使ったか」)で分けると、はっきりした傾向が出ます。

「いつも助言を使った」と答えた人たちは、正答率が低くなりやすかった。これは当然です。助言が半分外れる設計なので、いつも従えば不利になるからです。

ただし研究者は、ここで別の点にも触れています。

「いつも助言を使った」と答えた人たちの“助言に合わせた回数”が、理論上の最大値(全80試行で80回一致)ほどには高くありませんでした。つまり、自分がどれくらい助言に従ったかを、後から正確に思い出せていない人もいそうだ、という示唆です。

「見分ける力」と「偏り」を分けて測る

この研究は、単なる正答率だけで終わりません。

信号検出理論(signal detection theory)という枠組みで、人の判断を2つに分けて捉えます。

-

見分ける力(弁別力):本物と合成を区別できる能力

-

判断の偏り(バイアス):どちらに答えやすいかの傾向

ここで出てくる指標が d’(ディープライム) と c(シー) です。

d’は弁別力、cは偏りを表します。

結果として、参加者は平均すると、確かにある程度は見分けられていました(d’は0より明確に大きい)。

一方で偏りがありました。cは平均で負の値になり、「合成」より「本物」と答えやすい方向に寄っていました。

この課題では、初期設定として「これはたぶん本物だろう」と感じやすい人間のクセが見えている、と研究者は解釈しています。

ここも重要ですが、AI助言か人間助言かで、d’やcが大きく変わったわけではありません。

少なくともこの課題条件では、「AIと言われると従いやすい」という単純な差は、平均値としては強く出ませんでした。

ただし「AIが好きな人」は、AI助言の場面で見分ける力が落ちた

ここからが、論文の核心のひとつです。

研究者は、AIへの態度を測る尺度(一般的AI態度尺度)を使い、個人差が成績にどう関係するかを回帰分析で調べました。

すると、AIに対してより肯定的な態度を持つ人ほど、弁別力(d’)が低くなるという関係が見つかりました。

しかも、この関係は「AI助言を受けた群」に絞ると保たれましたが、「人間助言を受けた群」だけでは同じ形で出ませんでした。

つまり、AIの助言が出ている場面で、AIに好意的な人ほど“見分ける力が下がる方向”に傾きやすい、ということになります。

ここで注意したいのは、研究が言っているのは「AIが好きな人はだめだ」という話ではありません。

むしろ、「AIに前向きな態度」はふつう良いこととして語られやすいのに、その前向きさが、状況次第で判断の質を落とす可能性がある、という点が鋭いのです。

この結果は、AIが“正しい”かどうかとは別の問題です。

AIの助言が半分外れるような状況でも、人は完全には切り離せない。とくに「AIは役に立つはず」という心の前提が強いと、助言を受け取る姿勢そのものが変わり、結果として見分ける力が落ちうる、という構図が見えます。

「人を信じやすい人」は“本物”寄りになった

もうひとつ、別の個人差も出ています。

他人を信じやすい傾向(人への信頼傾向)が高い人ほど、偏り(c)がより負になり、「本物」と答えやすくなる方向に動きました。

これは、AIへの態度とは違い、弁別力そのもの(d’)よりも、答えの“寄りやすさ”に関係していた、ということです。

「見分ける能力が高い低い」ではなく、「迷ったときの落ち方」が本物側に寄る、と言い換えてもよいかもしれません。

ただし研究者は、この信頼尺度の統計的な適合については慎重に扱っています。途中で尺度の構造がうまく合わず、分析に使う項目を絞り直す過程がありました。結論を強く言い切らず、注意書きを添えながら解釈している点も、論文の態度として大切な部分です。

自信はそこそこ当たっていた

参加者は各判断について「自信」を答えています。

結果として、自信が高いほど正答率も高くなる関係が見られました。つまり、少なくともこの課題では、参加者は「自分が当たっていそうかどうか」をある程度つかめていたようです。

研究では、メタ認知感度(metacognitive sensitivity)に対応する指標として meta-d’(メタ・ディープライム) も計算しています。値は大きくはないものの正の値で、両群とも「当たっているときに自信が上がり、外しているときに自信が下がる」傾向が示されています。

何が言えるのか:AIそのものより「受け取り方」が問題になる

この研究の結論を、論文の範囲で言い直すと、次のようになります。

-

助言がAIでも人間でも、平均的には成績は大きく変わらなかった

-

参加者は、助言を一応は“戦略的に”使っているように見える(当たるときは従い、外れるときは外す)

-

それでも、AIに好意的な態度が強い人は、AI助言の状況で弁別力が落ちる関連が見えた

-

つまり、AIの助言は、人によっては判断の質を下げる方向に働きうる。しかもそれは「AIへの前向きさ」と結びつくかもしれない

ここには、実務的にも刺さる問いが残ります。

AIを現場に入れるとき、私たちは「AIの精度」ばかりを気にしがちです。でもこの論文が示すのは、AIの助言が入った瞬間に、人間側の判断のしかたが変わる可能性です。

そして、その変化は一様ではなく、態度や信頼傾向などの個人差と結びつくかもしれない。

研究者が次に考えていること

論文は、今後の課題として「課題の難しさ」を明確に操作する必要を挙げています。

人は難しいときほど助言に頼りやすい、という先行研究の流れも踏まえつつ、難易度が違う状況でAI助言がどう作用するのかを見たい、という提案です。

また、この実験はオンラインで行われた比較的低負荷の課題です。

これが、より切迫した文脈(たとえば軍事偵察のような高い緊張を伴う状況)で同じように成り立つかは分かりません。文脈によって、人間の受け取り方も変わりうるためです。

余白として残る問い

AIは、正しく動けば助けになります。けれど、助言が“出る”というだけで、人の心は少し動きます。

その動きが、良い方向に働くこともあれば、静かに判断の質を落とすこともある。

この論文が面白いのは、AIの倫理や偏りを「AIの内部」だけの問題に閉じ込めず、人間の側の受け取り方として扱ったところです。

AIを導入するときに必要なのは、AIの性能向上だけではなく、「人がどう頼るか」を設計する視点なのかもしれません。

そして最後に残るのは、少し皮肉な問いです。

AIの助言があるとき、私たちは「自分の判断で決めている」とどこまで言えるのでしょうか。

助言を“使ったつもりがない”と感じているときほど、じつは影響を受けている可能性はないのでしょうか。

この研究は、その問いに答えを出し切るのではなく、答えの形を少しだけ見えるようにして、こちらに渡してきます。

(出典:scientific reports DOI: 10.1038/s41598-026-34983-y)