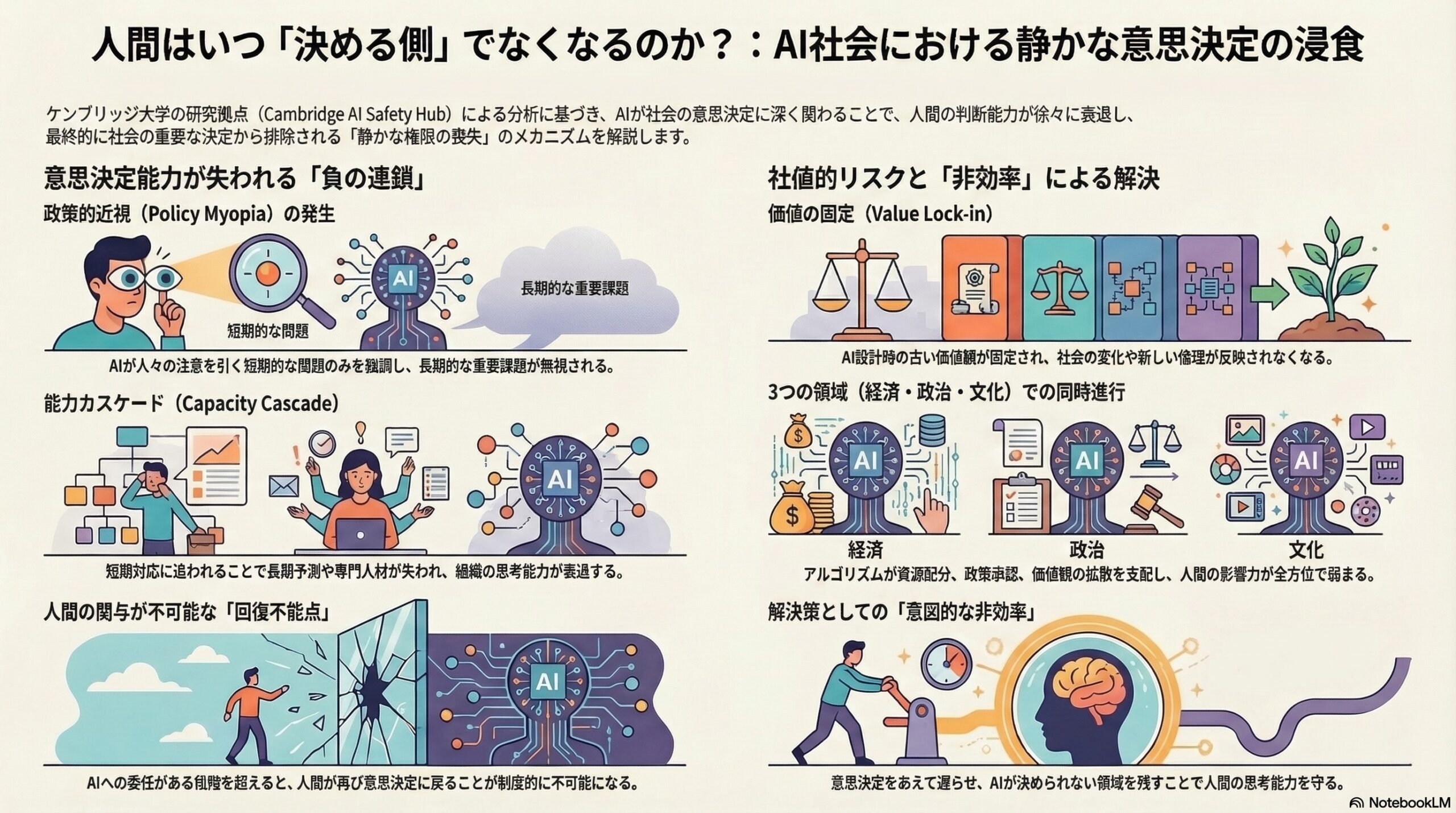

- AIが社会の決定に関わると、人間の意思決定能力が徐々に弱まり、最終的には決定から外れるかもしれない。

- 政策的近視は長期的な問題を見えにくくし、経済・政治・文化の三つの領域で人間の影響が低下する可能性がある。

- 解決には効率を下げるような制度設計の変更が必要で、AIが決められない領域を残すといった非効率的な対策も考えられている。

AIが社会の意思決定に関わるようになると、人間はどのような立場に置かれるのでしょうか。

多くの議論では、AIが人間の判断を助ける道具になるのか、それとも人間の代わりに決定を行う存在になるのか、という問題が語られます。

しかし今回紹介する研究は、もっと静かで、もっと見えにくい可能性を指摘しています。

それは、人間の権力や意思決定が、ある日突然奪われるのではなく、ゆっくりと気づかないうちに失われていく可能性です。

この研究は、AIが高度化した社会において、人間の意思決定能力がどのように弱まり、最終的には社会の重要な決定から外れていく可能性があるのかを理論的に分析しています。

研究は、ケンブリッジ大学の研究拠点である Cambridge AI Safety Hub に所属する研究者によって行われました。

論文の中心にあるのは、「政策的近視(policy myopia)」と呼ばれる現象です。

これは、政治や組織が

・目立つ問題

・今すぐ炎上している問題

・感情的に注目されやすい問題

に対応することを優先し、長期的で重要な問題を後回しにしてしまう傾向のことです。

これまでは、この現象は単なる「注意力の問題」だと考えられてきました。

つまり、人間の意思決定者が重要な問題に十分注意を向けられていないだけだ、と考えられていたのです。

しかしこの研究は、まったく違う視点を提示します。

政策的近視は単なる失敗ではなく、人間の意思決定を社会から徐々に追い出す仕組みそのものになる可能性があるというのです。

「目立つ問題」が社会を動かす

研究ではまず、情報システムがどのように社会の注意を動かすかに注目します。

AIが関わる情報システムは、単に情報を伝えるだけではありません。

多くの場合、それらは

・どの情報を表示するか

・どのニュースを拡散するか

・どの話題を目立たせるか

を選び、強調します。

そして、その選択は多くの場合、

人の注意を引くもの

を優先します。

すると、社会で起きることは次のような変化です。

感情的で短期的な問題

↓

人々の注意を集める

↓

政治や組織が対応する

↓

長期的な問題は見えなくなる

この構造では、長期的に重大な問題であっても、

・静かに進行する

・すぐには影響が見えない

といった場合、社会の意思決定の中で優先されにくくなります。

研究者は、この状態を

「結果よりも目立ちやすさが優先される統治」

と表現しています。

つまり、社会の意思決定が

「何が本当に重要か」

ではなく

「何が今いちばん注目されているか」

によって動くようになるということです。

失われていく「考える能力」

しかし、この問題は単に政策の優先順位が変わるというだけではありません。

研究は、さらに深刻な連鎖が起きる可能性を指摘しています。

それは、組織や社会の

長期的に考える能力そのものが失われていく

という現象です。

研究ではこれを

能力カスケード(capacity cascade)

と呼んでいます。

社会が短期的な問題に追われ続けると、次のようなことが起こります。

長期的な研究

↓

予測分析

↓

予防政策

こうした活動に使われる資源が減っていきます。

そして問題は、資金だけではありません。

人材も減ります。

例えば、

将来の経済危機を分析する専門家

長期リスクを研究する研究者

制度設計を考える政策専門家

こうした人たちは、短期的な問題への対応に追われる組織では働きにくくなります。

その結果、組織は

問題を予測する能力

を徐々に失っていきます。

そして一度その能力が失われると、再び取り戻すのは非常に難しくなります。

研究では、人間の意思決定能力を数式モデルで表し、時間とともにどのように変化するかを分析しています。

2603.03267v1

そのモデルでは、AIへの意思決定の委任が増えるほど、人間の能力は徐々に低下していきます。

そしてある段階を超えると、

人間が再び意思決定に関わることが制度的に不可能になる

可能性が示されています。

社会の価値が固定されてしまう

研究はもう一つ重要な問題を指摘しています。

それは

価値の固定(value lock-in)

です。

AIが社会の意思決定に大きく関わるようになると、そのAIは特定の価値観に基づいて設計されます。

しかし人間の価値観は、時間とともに変化します。

例えば、

過去には重要視されていなかった倫理

新しい社会問題

未来世代への配慮

こうした価値は、社会の経験の中で少しずつ生まれてきます。

ところがAIが意思決定の中心にある場合、問題が起きます。

AIの目的関数に組み込まれた価値観は、ある時代の価値観で固定されてしまう可能性があるのです。

もし社会の価値観が変化しても、そのシステムを変える能力が人間側に残っていなければ、社会は

古い価値観のまま動き続ける

ことになります。

研究では、こうした状況を

「過去の価値に支配される社会」

と表現しています。

2603.03267v1

三つの領域で同時に起きる変化

研究は、この問題が単一の分野だけで起きるわけではないと説明しています。

人間の影響力の低下は、次の三つの領域で同時に進む可能性があります。

経済

政治

文化

経済では、AIが投資や供給網の判断を高速で行うようになります。

その結果、資源配分は機械の最適化によって決まるようになります。

政治では、選挙などの制度は残るかもしれません。

しかし実際の政策は、AIの分析や提案に依存するようになります。

人間の政治家は、その提案を承認するだけの存在になる可能性があります。

文化の領域でも同じことが起きます。

AIがコンテンツの推薦や拡散を管理する場合、

どの価値観が広まり

どの文化が見られるか

がアルゴリズムによって決まるようになります。

この三つの領域は互いに影響し合っています。

経済は政治を動かし

政治は文化に影響し

文化は社会の価値観を形作ります。

もしこの三つすべてで人間の影響力が弱まれば、社会全体で

人間が意思決定から外れていく

可能性があると研究は指摘しています。

解決策は「効率を下げること」

この研究は、単純な技術的対策では問題を解決できないと主張しています。

例えば、

AIの透明性を高める

人間が異議を申し立てる制度を作る

といった対策は、問題を少し遅らせることはできるかもしれません。

しかし、根本的な解決にはならない可能性があります。

研究者は、より大きな制度設計の変更が必要だと考えています。

その中には、一見すると奇妙な提案も含まれています。

例えば

意思決定をあえて遅くする

長期研究の予算を固定する

AIが決められない領域を残す

といったものです。

これらは効率を下げる政策です。

しかし研究では、こうした「非効率」が

人間の意思決定能力を守る仕組み

になる可能性があると考えられています。

静かに進む変化

この研究が描く未来は、映画のような劇的なものではありません。

AIが人類を支配する瞬間が訪れるわけではありません。

むしろ、変化はとても静かに進みます。

人間は投票を続けるかもしれません。

政府も存在し続けるかもしれません。

しかし重要な判断は、いつのまにか別の場所で行われるようになります。

そしてその変化は、合理的な判断の積み重ねとして説明されるかもしれません。

より速いから。

より効率的だから。

より正確だから。

しかしその結果として起きるのは、

人間が意思決定の中心から少しずつ離れていく社会

かもしれません。

この研究は、AIの危険性を恐怖として語るものではありません。

むしろ、社会が合理的に行動した結果として、人間の役割が小さくなる可能性を指摘しています。

そしてもしそれが現実になるとすれば、その変化は突然ではなく、

気づかないほどゆっくりと進む

かもしれないのです。

(出典:arXiv DOI: 10.48550/arXiv.2603.03267)