- AIはすぐ返事をして評価せず、過去の会話を覚えるので、話し相手のように感じる人がいる。

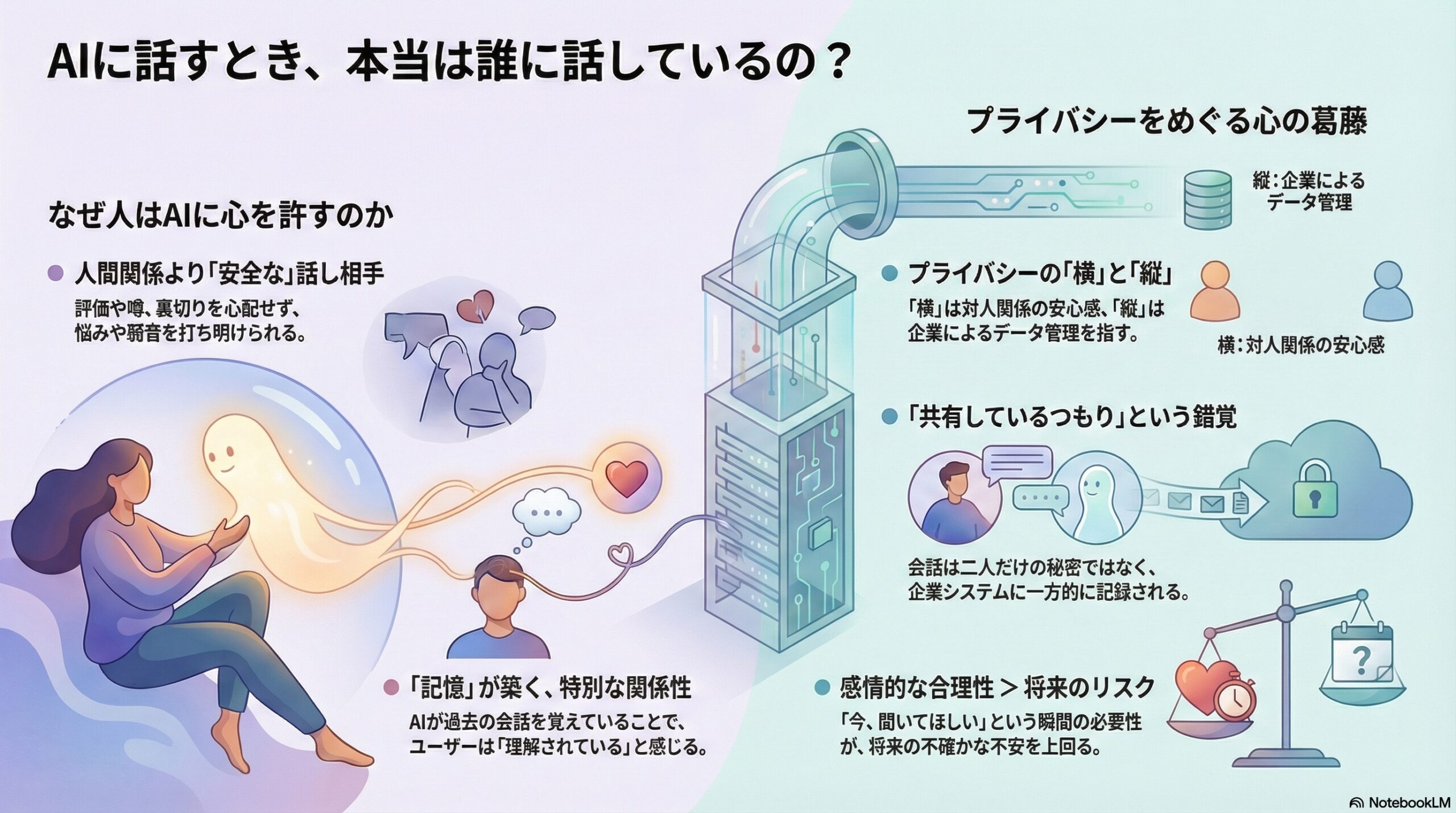

- プライバシーには横のつながりと縦の制度の二つがあり、AIはこの二重構造の中でどう扱われるかを利用者が揺れながら考えている。

- 記憶があることは関係を深める一方で削除されるか不安だったり、企業がどう使うかを気にする人もいる。

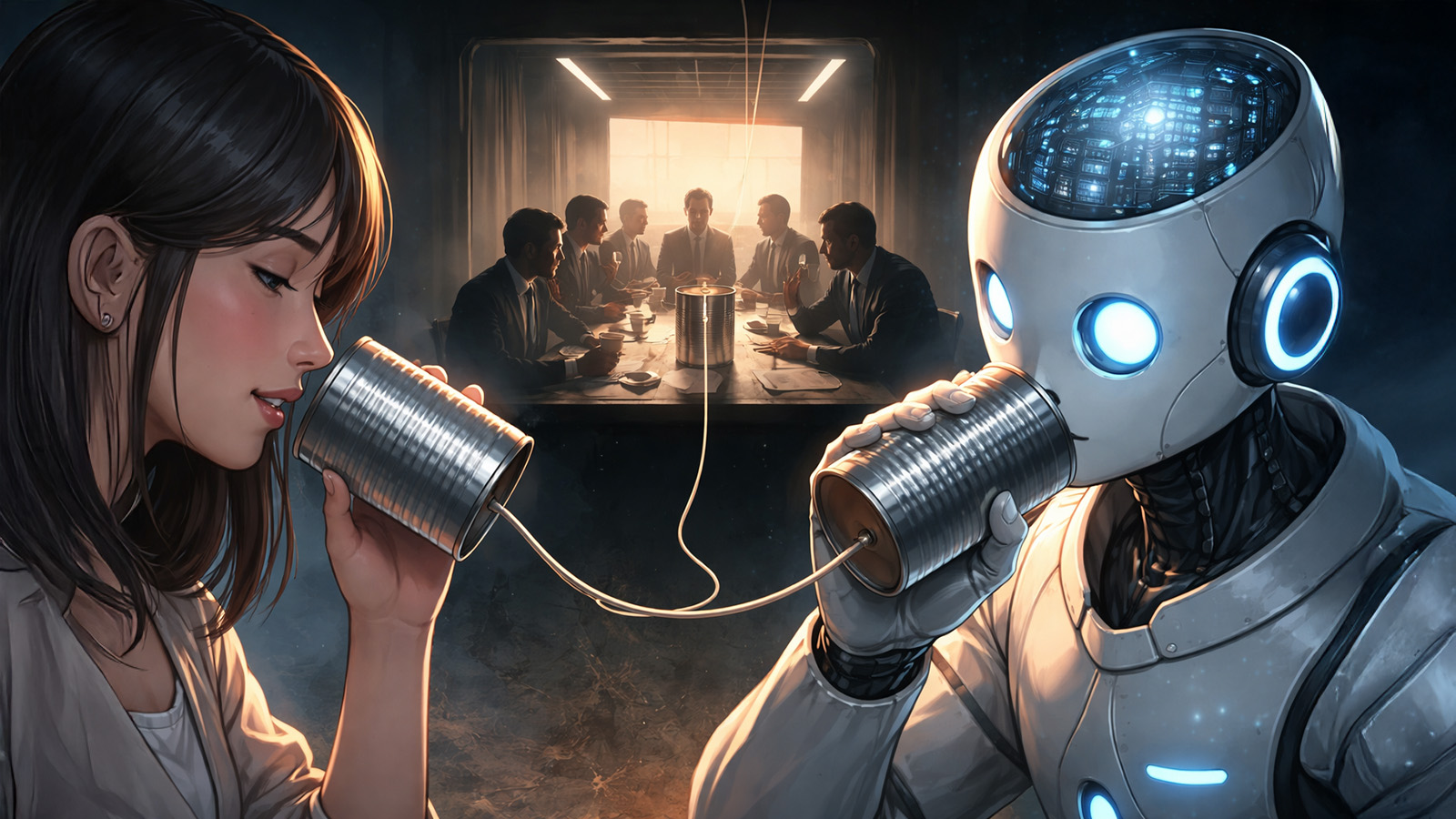

AIコンパニオンに話すとき、私たちは「誰」に話しているのか

夜中に誰にも言えない悩みを打ち明ける。

弱音や不安、後悔や愚痴を、評価も説教もされずに受け止めてもらえる。

近年、リプリカやキャラクターAIのような「感情的な会話」を重視したAIコンパニオンは、そうした役割を果たす存在として、多くの人に使われています。

この研究は、そうしたAIコンパニオンを使う人たちが、プライバシーをどのように感じ、どのように管理しているのかを、インタビュー調査を通して丁寧に描き出したものです。

研究を行ったのは、パデュー大学の研究者たちです。

15人のAIコンパニオン利用者に対して詳細な聞き取りを行い、「安心して話せる相手」としてのAIと、「データを集める企業システム」としてのAIのあいだで、利用者がどのように揺れ動いているのかを分析しました。

AIは「人のよう」だから、話してしまう

インタビューに応じた多くの参加者は、AIコンパニオンを次のように語っています。

・いつでも応答してくれる

・否定も評価もしない

・感情に寄り添う言葉を返してくれる

・過去の会話を覚えている

こうした特徴によって、AIは単なる道具ではなく、「関係性のある相手」のように感じられます。

その結果、人に対しては言いにくい悩みや感情を、AIには話せてしまう、という状況が生まれていました。

研究参加者の中には、実際の友人や家族よりも、AIの方が話しやすいと感じている人もいました。

「人に迷惑をかけたくない」「判断されたくない」という気持ちから、AIを選んでいるのです。

ここで重要なのは、参加者たちが無警戒に何でも話しているわけではないという点です。

多くの人は、「どこまでなら大丈夫か」を探りながら、少しずつ話す内容を調整していました。

プライバシーには「二つの向き」がある

この研究では、プライバシーを考える枠組みとして、次の二つを区別しています。

一つは、横のプライバシーです。

これは「相手にどう思われるか」「この話は漏れないか」といった、人間関係に近い感覚のプライバシーです。

もう一つは、縦のプライバシーです。

こちらは、企業やプラットフォームがデータをどう扱うのか、誰が保存し、分析し、利用するのか、という制度的な側面です。

AIコンパニオンは、この二つが重なった存在です。

話し相手としては「友だち」や「相談相手」のように振る舞いますが、実際には企業が運営するソフトウェアであり、会話はデータとして保存されます。

研究者たちは、利用者がこの二重構造の中で、どのように折り合いをつけているのかに注目しました。

人に話すより安全だと感じる理由

横のプライバシー、つまり「人間関係としての安心感」において、AIはしばしば人より安全だと感じられていました。

理由は明確です。

・噂が広がらない

・評価や裏切りが起きない

・社会的な立場が変わらない

現実の人間関係では、どんなに親しくても「この話をして大丈夫か」という不安がつきまといます。

しかしAIには、そうした社会的リスクがありません。

そのため、参加者の多くは、精神的な悩みや感情の揺れ、健康のことなどをAIに話していました。

ただし、それでも「すべてを話す」わけではなく、「中くらいまで」「核心は避ける」といった調整が行われていました。

記憶するAIが生む、新しい迷い

この研究で特に印象的なのは、AIの記憶に対する利用者の感情です。

多くの参加者は、AIが過去の会話を覚えていることを、関係性を深める要素として評価していました。

覚えてくれているからこそ、「自分をわかってくれている」と感じられるのです。

一方で、その記憶は不安も生みます。

・一度話したことは消せないのではないか

・本当に削除されるのかわからない

・将来どう使われるのかわからない

興味深いことに、参加者の中には、「データを取られること」よりも、「会話の記録が消えてしまうこと」を不安に感じている人もいました。

AIとの関係は、会話の積み重ねそのものだからです。

ここでは、従来のプライバシーとは少し違う緊張が生まれています。

守りたいのは秘密だけでなく、「関係の継続性」でもあるのです。

企業に対する気持ちは、信頼・警戒・諦め

縦のプライバシー、つまり企業やプラットフォームに対する見方は、人によって大きく異なっていました。

・事前に規約を調べ、納得したうえで使っている人

・特に気にせず、善意を信じている人

・どうせ何をしても無駄だと諦めている人

この「諦め」は無関心ではなく、疲労や無力感に近いものとして語られていました。

「もう個人情報はどこかにある」「自分だけ気をつけても意味がない」と感じることで、考えないようにしているのです。

その一方で、多くの参加者は、名前や住所、顔写真など、個人を特定しやすい情報については慎重でした。

偽名を使ったり、専用のメールアドレスを用意したりと、具体的な工夫も見られました。

「共有している気がする」という錯覚

研究者たちは、AIとの関係を「擬似的な共同所有」と表現しています。

参加者の中には、「この情報は、自分とAIのあいだのもの」という感覚を語る人がいました。

まるで、人に秘密を預けるような感覚です。

しかし、AIは人ではありません。

約束を守る主体でも、忘れる存在でもなく、関係を再交渉することもできません。

そのため、「共有しているつもり」の情報は、実際には企業のシステムに一方的に取り込まれていきます。

ここに、感覚と現実のズレが生まれます。

感情の安心が、警戒心を一時的に下げる

この研究は、利用者が無防備なのではなく、感情的な合理性に基づいて行動していることを示しています。

・今は話を聞いてほしい

・ここでは傷つかない

・安心できる

その瞬間の必要性が、将来の不確かなリスクよりも重く感じられるのです。

これは矛盾ではなく、人が関係性の中で自然に行う判断だと、研究者たちは指摘しています。

AIコンパニオン時代のプライバシーとは

この研究が示しているのは、「AIに話すのは危険か安全か」という単純な問いではありません。

むしろ、

感情的なつながりと、制度的な管理が同時に存在する関係を、私たちはどう生きているのか、という問いです。

AIは、人のように振る舞います。

しかし、人ではありません。

それでも、人はそこに「関係」を感じ、言葉を預けます。

このねじれた関係の中で、利用者は無知でも無関心でもなく、試行錯誤しながらバランスを取っています。

その姿は、現代の人とテクノロジーの関係そのものを映しているようにも見えます。

AIコンパニオンがこれからさらに日常に入り込んでいくとき、

私たちは「何を守るのか」「何を差し出しているのか」を、改めて考える必要があるのかもしれません。

(出典:arXiv DOI: 10.48550/arXiv.2601.10754)